字数 605,阅读大约需 4 分钟

Hugging Face助力开发者,轻松在第三方云运行AI模型

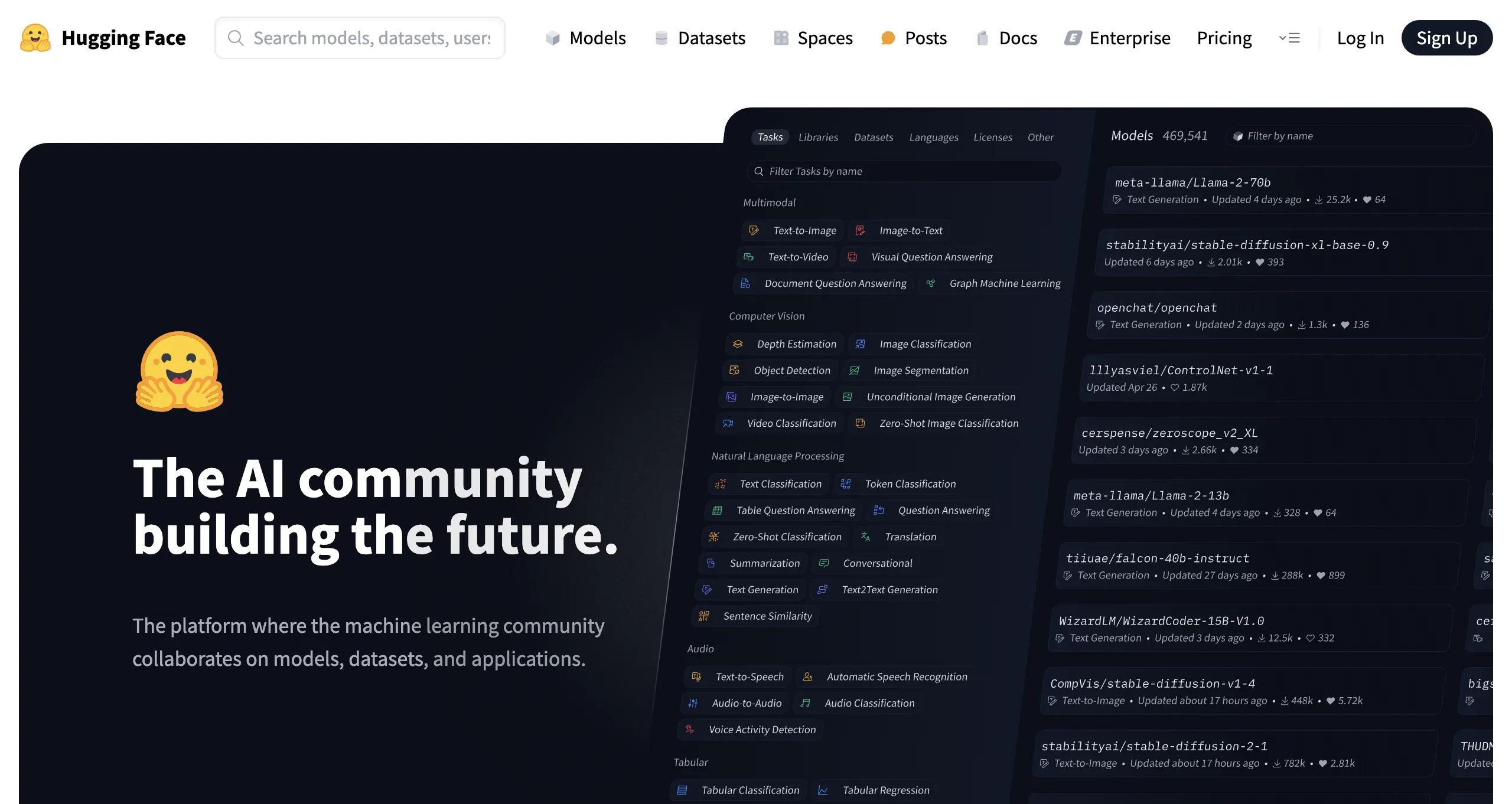

Hugging Face作为全球知名的AI模型托管与开发平台,近期与多家第三方云供应商达成合作,其中包括SambaNova、Fal、Replicate和Together AI等,共同推出了一项名为Inference Providers的特色功能。这一举措旨在帮助开发者更便捷地利用自己选择的基础设施,在Hugging Face平台上运行AI模型。

合作背景:Hugging Face自2016年从一家聊天机器人初创公司起步,发展至今已成为全球最大的AI模型托管与开发平台之一。截至目前,该公司已从Salesforce、Google、Amazon和Nvidia等投资者处筹集了近4亿美元资金,并宣称实现盈利。长期以来,Hugging Face一直提供自家内部解决方案来运行AI模型,但如今其重点已转向合作、存储及模型分发能力。

功能优势:以此次合作为契机,开发者现在能够通过Hugging Face平台,轻松使用合作方的数据中心资源。例如,只需在Hugging Face项目页面上点击几下,就能在SambaNova的服务器上启动DeepSeek模型。这种“无服务器推理”模式,让开发者无需配置或管理底层硬件,就能实现AI模型的部署与扩展。像SambaNova这样的供应商,会根据使用情况自动启动所需的计算资源,并进行动态的资源缩放。

费用说明:就目前而言,通过Hugging Face平台使用第三方云供应商服务的开发者,将按照标准的供应商API费率支付费用。Hugging Face方面表示,未来可能会与供应商合作伙伴达成收益共享协议。此外,所有Hugging Face用户都能获得一定额度的推理信用额度,而Hugging Face Pro的订阅用户,每月还能额外获得2美元的信用额度。

Hugging Face的这一创新举措,无疑将为AI开发者带来更灵活、高效的开发体验,推动AI技术在更广泛领域的应用与发展。