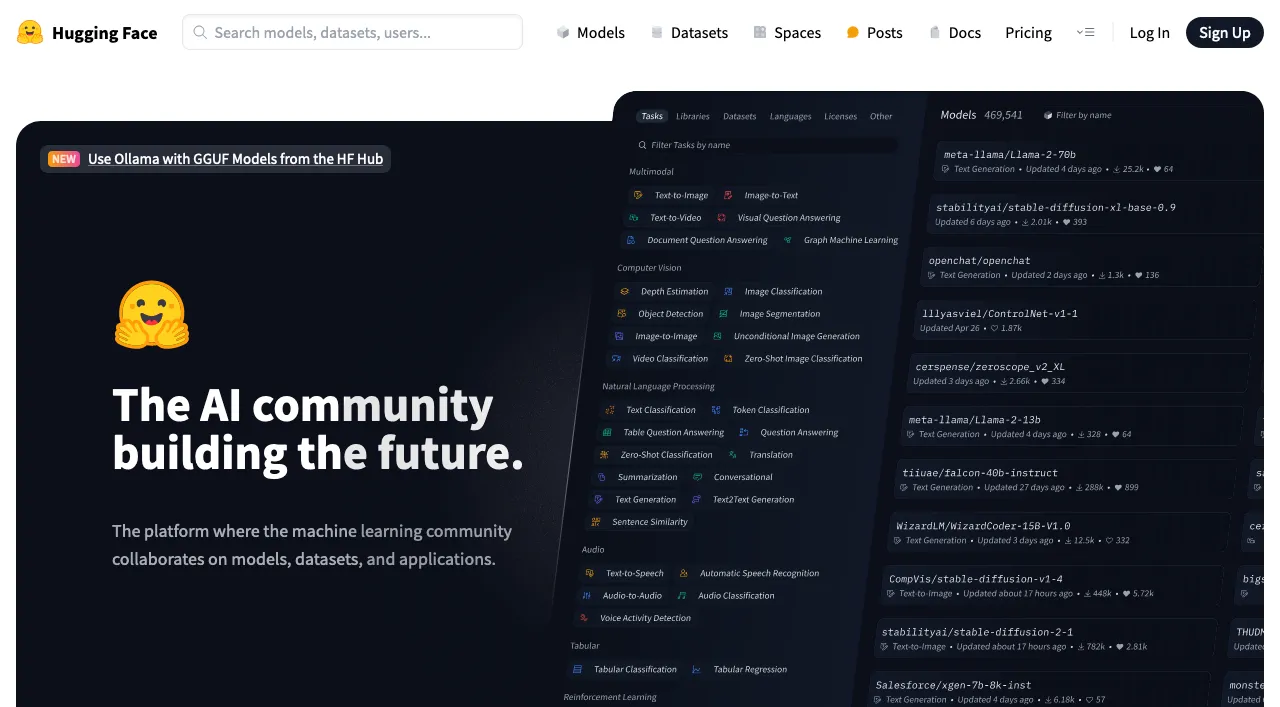

Hugging Face 推出小巧AI模型,助力设备性能提升

近期,人工智能开发平台Hugging Face团队有了新动作,发布了两款新型AI模型——SmolVLM – 256M和SmolVLM – 500M。这两款模型号称是目前体积最小的AI模型,在处理图像、短视频和文本数据方面展现出独特优势,尤其适合内存少于1GB的设备,如笔记本电脑,为开发者提供了高效低成本的数据处理方案。

模型参数与能力提升

这两款模型的参数分别为256百万和500百万。通常在AI领域,参数越多,模型解决问题的能力越强,所以这两款模型在性能上有相应提升。它们能够执行多样化任务,例如对图像或视频片段进行描述,以及回答关于PDF文档及其内容的问题,像扫描文本和图表等,在教育、研究等诸多领域有着广泛的应用前景。

训练数据集

在模型训练过程中,Hugging Face团队使用了名为“The Cauldron”的50个高质量图像和文本数据集,以及名为Docmatix的文件扫描和详细说明配对的数据集。这两个数据集均由Hugging Face的M4团队开发,专注于多模态AI技术的发展,为模型的强大性能奠定了基础。

性能表现对比

值得一提的是,SmolVLM – 256M和SmolVLM – 500M在各类基准测试中表现出色,优于许多更大模型,如Idefics80B。特别是在AI2D测试中,它们分析小学生科学图表的能力十分突出。不过,小型模型虽价格亲民且功能多样,但在复杂推理任务上存在短板。一项来自Google DeepMind、微软研究院以及魁北克Mila研究所的研究表明,许多小型模型在复杂任务上表现欠佳,研究人员推测原因可能是小型模型倾向于识别数据的表面特征,在新情境中应用知识时较为困难。

对于广大开发者而言,若希望以低成本实现高效数据处理,Hugging Face的SmolVLM系列模型无疑是不错的选择。它为内存有限的设备带来了新的AI应用可能,有望在更多领域发挥作用,推动行业发展。